仕事がなくなるのは自動運転のせいではなくカーシェアのせい

本日公開されたニュースによると、GMが管理職を25%, 従業員を15%減らし5つも工場を減らすらしいです。

GMが大規模リストラ発表 「電気自動車や自動運転にフォーカスするため」https://t.co/uo974l7HO3 pic.twitter.com/4fCUVfOmhX— ITmedia NEWS (@itmedia_news) 2018年11月27日

もちろんGMだけの問題ではありません。

自動車業界ではこれから同じことが各社で起きる可能性があります。

めちゃめちゃ職を失う人が出るわけですが、これは自動運転のせいなのでしょうか。

クルマの「完全自動運転」でなくなる職業・モノ全リスト https://t.co/YjQgJmZcNj #現代ビジネス— 現代ビジネス (@gendai_biz) 2017年12月12日

こんな記事流行りましたね。

たしかに今回の変革は「自動運転にフォーカスするため」と書いています。

が、だったら5つも工場を閉じるのは話が飛びすぎです。

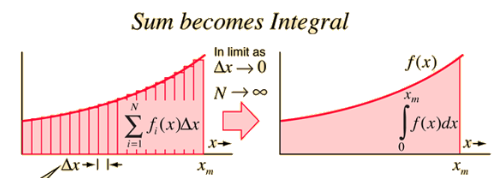

自動運転によってカーシェアが普及する

→車の台数が減るから工場を減らす

→ビジネスモデルが変わるから既存ビジネスの社員減らす

なわけです。

でもカーシェアなんてそんな普及しないっしょ、と思っている方のために次で深堀りします。

カーシェアはエネルギー問題の一つの解決策

前章で「自動運転によってカーシェアが普及する」と書きましたが、厳密には違います。

そもそも今大して自動運転存在しないのにカーシェア普及し始めてますし。

月額基本料がかからないのはいいですね— 世界四季報(セカ報) (@4ki4) 2018年11月19日

カーシェア、月会費無料が続々 長期間借りっぱなしも:日経https://t.co/QtsM0T3oyx …

>2018年の会員数は前年比21.6%増の約132万人、車両数も同19.4%増の2万9200台。自家用乗用車の6000万台超はもちろん、レンタカーの60万台超とはまだ大きな差がある。 pic.twitter.com/sUOXoomeGC

カーシェアが普及すると、

- ユーザーが便利: 維持費なく新しい車に必要なだけ乗れる

- ユーザーが快適: 車の総数が減るので渋滞も減るし駐車場もガラガラになる

- 国が嬉しい: 渋滞、排ガスによる経済的損失が減る←重要

そう、エネルギー問題解決に貢献するのです。国的にはこれ大事。

貧しい人というのは、多くを持たないもののことではない。多くを求めるものをいうのだ。―ムヒカ元ウルグアイ大統領 pic.twitter.com/AkYMFoWCBv— Liberal Japan (@LiberalJapan) 2018年11月27日

消費を減らしゴミを減らす。

消費を減らすための一つの答えがカーシェアであり、それを加速するのが自動運転。

そしてゴミを減らすためにガソリン脱却・電動化が求められる。

この清く、正しい考えにより多くの人が失業するわけです。

仕事は増える

とはいえ、消費を減らしてゴミを減らすのは簡単ではないです。

例えばご飯。

ファミレスではメニュー通り料理が提供されますが、毎日大量の残飯が捨てられています。

客の空腹度が数値化できれば料理の量をカスタマイズできます。

例えば電気。

誰もいないオフィスの電気は自動で消せるし、昼の消費量ピーク時は電気代を上げて昼休みをシフトさせたり。

「ケンブリッジTOUモデル」が遂に結果出してる!!(ちょこっと手伝ってました)— ysmrnbt (@ysmrnbt) 2018年11月27日

日本初となるスマートメーターデータを活用したTOU料金の実証実験の成果発表 ~AIによる数値予測通り平均9.2%の電気代削減と7.7%の電力消費量削減に成功~ https://t.co/D6XawcQEr0

モノづくりよりシステムづくりが増えるだけで、仕事は増えると思いますよ。

という説を提唱する者でした。

おしまい。